-

空速计选型干货:为什么说DLVR-L10D-E1BD-I-NI3N是固定翼无人机的理想选择?

-

一路I2C上链接2个两个相同地址的传感器元件,如何实现读取操作?

-

传感方寸,低空广阔:盛思瑞特以微传感器筑梦低空经济,亮相2026无人机大会

-

为什么IST流速传感器很合适做MFC的核心?

-

动态血压监测新选择:US6330-006E-AQ为何比进口芯片更胜一筹?

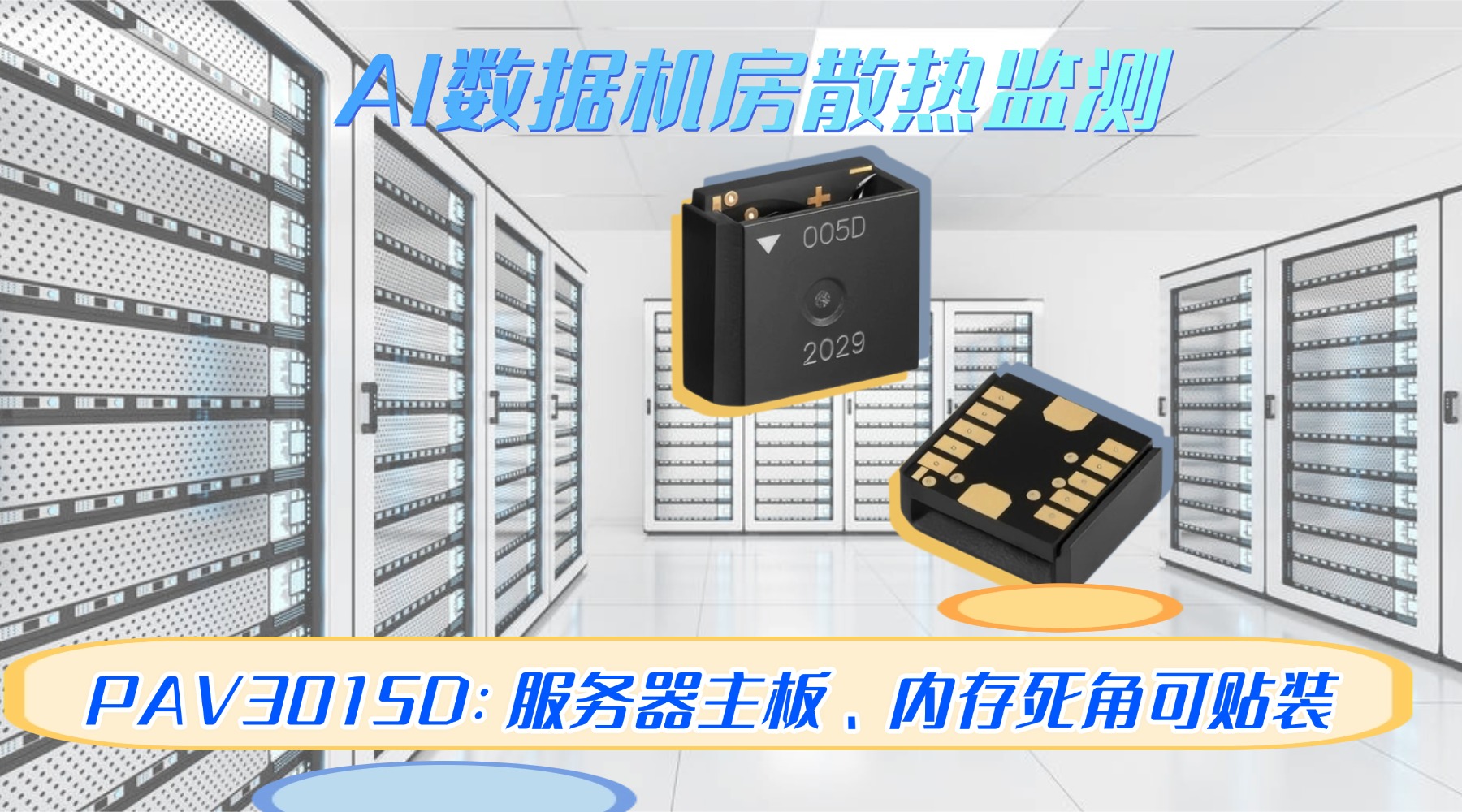

想象一下这样一幅场景,一台价值几百万的AI训练集群正在满载运行,突然就出现了高温降频的情况,这时候负责运维的工程师火速去排查液冷系统,然后发现冷却液流量是正常的,冷板温度也是正常的,连冷量分配单元(CDU)都处于平稳运行的状态。那问题究竟出在哪里呢?那些经验丰富的工程师其实都知道,答案往往藏在液冷管路根本覆盖不到的那些犄角旮旯的地方,比如内存条之间的缝隙、高速存储设备的周边、还有VRM供电的那些死角。这些地方在看起来可能不起眼,但只要局部风速稍微衰减那么一点,热量就会迅速堆积起来,最终影响到整个系统的性能。这就是现阶段高功率密度数据中心最需要面对的一个反常识的事实,即使那些昂贵的液冷系统发展到了极致,能够担负起高达95%的散热重任,剩下那看起来微不足道5%的残余热量,依然是能决定整个系统生死存亡的大问题。更何况目前主流方案的液冷覆盖率还停留在60%-80%这个区间,风冷面临的局部热点问题依然严峻。所以,无论是在PUE考核日益严苛的今天,还是着眼可预见的未来,“风液协同”都将是高密度数据中心无法绕开的真实形态。这篇文章我们将从底层物理逻辑出发,重新审视液冷时代被忽视的风冷挑战,探讨如何借助MEMS固态传感技术,以较低成本方式补齐热管理闭环的最后一块拼图。

液冷不是风冷的终结者

算力跃迁带来热量飙升传统数据中心的那个温和时代已经成为了过去式。以前单机柜5-8kW的时代,机房空调加上粗放风冷这套打法确实是够用的。那个时候去现场调参数,基本就是看温度、调风机转速,没有太多复杂的逻辑在里面。但现在AI算力的爆发彻底打破了这种平衡。NVIDIA DGX H100单台峰值功率突破了10kW,新一代的DGX B200更是攀升到了14kW以上。在实际的AI训练集群当中,单机柜的功率密度已经普遍达到了40-60kW这个范围,部分液冷整机柜甚至正在朝着100kW+的方向迈进。在这个量级下面,散热早就不是什么配套工程了。它会直接影响到系统架构的成败和投资回报,是真正的核心生命线。

液冷边界与残余热量面对极高的局部热通量,冷板式液冷凭借水单位体积热容量远高于空气的优势,顺理成章地成为了CPU、GPU等高发热芯片的最优解。然而,根据ASHRAE(美国采暖、制冷与空调工程师学会)指南显示,冷板液冷通常只能带走服务器总发热量的60%-80%。这意味着,剩余那20%-40%的热量依然完全需要依赖风冷进行对流散热。这部分所谓的残余热量并非无足轻重的零头,而是实实在在地堆积在周边组件上。就比如说内存模块,DDR5-4800单条32GB内存的典型功耗大概是8-10W。AI服务器通常会配置16-24条内存,仅这一项的总功耗就可以达到128-240W。再比如高性能存储,企业级NVMe SSD在高负载下面单盘功耗可以达到15-25W,举例,Intel Optane P5800X的峰值能达到25W。还有电源与供电网络,即便是采用80 PLUS Titanium级别的高效电源,转换效率达到了96%,仍然会有4%的巨大能量会以纯热能的形式散发出来。

致命的 5% 绝对值全系统直接液冷技术一直在持续演进,针对NVIDIA GB200架构的部分最新液冷方案热捕获率已经标称达到了95%甚至更高。那风冷是不是就可以退场了?现实情况恰恰相反,液冷覆盖率越是极致,风冷的容错空间就越小。如果只看百分比的话,5%好像微不足道。但让我们回到绝对值来分析一下。传统风冷时代:总功率 7 kW × 风冷承担 100% =绝对发热量 7 kWAI超高密时代:总功率 130 kW × 风冷仅承担 5% =绝对发热量 6.5 kW6.5kW到底是什么概念呢?也就是说,就算液冷系统包揽了95%的工作,剩下的5%风冷残余热量,依然相当于一整台传统风冷机柜的全部发热总和。更难处理的是,液冷管路和CDU占据了大量的机箱空间,风道变得极其狭窄,并且这些热量还不是均匀分布的,而是集中在最难散热的死角里面。在这种状况下,任何一处气流盲区都有可能触发内存降频、电源保护,最终成为拖垮整个AI集群性能的那块木桶短板。

风速衰减的非线性破坏

风速是唯一的动态控制变量服务器热力学系统的对流散热,由一个核心公式支配着,那就是:Q = Cp × ρ × V × A × ΔT其中,Q代表散热量,Cp代表空气比热容,ρ代表空气密度,V代表风速,A代表有效截面积,ΔT则代表温升。如果我们把这个公式里的变量进行逐一拆解,就会发现,Cp和ρ是物理常数,系统改变不了,A受机箱物理尺寸限制基本也是固定的,而V也就是风速,是唯一可以毫秒级动态调节的变量。换句话说,当系统发热量Q飙升、需要压住温升ΔT的时候,风速V就是系统集成商和运维团队手里唯一的那个旋钮。并且,这个旋钮的灵敏度远超大多数人的预期。

风速微降导致温升剧变为了验证这个旋钮的敏感度,我们可以做一次极限推演。假设一个标准的42U机柜,IT风冷侧负载为10kW。冷通道的送风温度为22°C,机柜进风口的有效面积大概是0.6m²。在正常工况下,当风速为1.5m/s的时候,我们代入公式计算一下,已知Cp大约是1.005kJ/(kg·K),ρ大约是1.225kg/m³,计算出来的温升ΔT大约是9.0°C。这个时候排风温度大概在31°C左右,系统处于绝对安全的绿区。但如果滤网积灰,导致风速隐蔽下降到1.0m/s,我们重新计算一下,就会发现温升ΔT急剧增加到了13.5°C,排风温度瞬间就飙升至35.5°C。这个简单的工程计算,却能揭示微环境散热的脆弱性,风速仅仅衰减了33%,温升幅度却暴涨了50%。在混合架构那些狭窄的风道里面,仅0.5m/s的微小风速衰减,就能对散热系统产生非线性的破坏效果。这不单单是理论推演,而是真实发生在高密度机柜里面的工程现实。

争夺秒级的预警时间差正因为风速衰减带来的破坏是非线性的,所以留给系统反应的窗口期其实极短。传统数据中心高度依赖温度传感器来做热管理决策,这套逻辑在低功率密度时代是没有问题的。但问题在于,温度变化是热量积累的滞后结果,从散热异常到温度告警,通常需要数分钟的演变时间;而风速变化像是风扇降速、滤网堵塞,这是散热能力丧失的直接原因,属于秒级的变化。这意味着,底层风速监测能为热管理系统提供比温度监控早10倍乃至100倍的预警时间优势。

对于单节点价值数百万的AI训练任务来说,这几分钟的提前干预,就是预防宕机、挽回经济损失的关键窗口。03 MEMS 纯固态风速感知在深入了解PAV产品价值之前,我们需要理解一个重要的背景,风速监测并非一个全新的概念,而是在传统低功率密度时代被边缘化、在AI时代又被急需唤醒的技术。

1)传统"三驾马车"的局限在传统的5-8kW机柜时代,数据中心热管理依赖一套以温度为主、压差和功率为辅的间接推算体系。这套体系在当年勉强够用,但在现阶段超高密度环境下面,三个结构性盲区同时爆发了。温度监测天生就是滞后的: 传统数据中心几乎完全依赖温度控制体系,涵盖机房环境、冷热通道、机柜前后门甚至服务器BMC内置传感器。

其核心局限在于,温度是热量积累的滞后结果,而非散热能力的实时指标。从散热异常到温度告警,通常需要分钟级的演变时间。过去还可以容忍,但在40-100kW的AI算力时代,几分钟的延迟可能意味着价值数百万的训练任务已经中断了,关键组件也触发热保护了。压差监测存在微观盲区: 通过监测架空地板下静压箱与地板上的压力差,典型值在20-50Pa这个范围,来判断送风系统的整体状态。 这个方案只能反映宏观送风能力,但是对单个机柜的实际进风量、气流短路、局部滤网堵塞这些问题,基本是无感的。功率推算基于脆弱的假设: 通过PDU实时功率数据按照功率约等于发热量进行间接推算,偶尔配合临时的风速测量。 这种推算建立在散热系统始终正常工作的前提上面,一旦遇到风扇老化衰减、滤网脏堵等物理问题,功率数据就完全无法反映真实状况了。而风速测量也只是临时测一测,无法构成闭环。综合而言,在液冷管路严重挤占风道的高密度场景下面,这三套方案的短板集中体现为预警时间不足(等温度告警已来不及)、定位能力缺失(知道“热了”,但不知道哪个风道堵了)、控制精度不够(无法为智能风机提供实时闭环反馈)。

2)PAV系列:专为恶劣环境设计的确定性感知面对如此苛刻的微环境要求,那些传统的机械式风速计和易温漂的分立式热敏电阻已经无能为力。Posifa PAV1000和PAV3000系列MEMS风速传感器,正是针对这一现实的工程需求研发的,无论是面对现有的存量数据中心改造,还是全新的AI算力集群建设,它都能提供最具性价比的确定性感知能力。两种部署场景: 在新建高密度AI架构当中,PAV系列可直接作为底层热管理系统的核心主导传感器,独立为局部智能变频风机提供毫秒级的实时闭环反馈,散热颗粒度可以精细到服务器板卡级。 而在存量数据中心改造方面,系统集成商不需要推翻现有的热管理架构,PAV系列凭借极小的体积和较低的成本,可以无缝挂载在现有的“温度+压差+功率”宏观监测网络下,为原本看不见的散热死角提供确定的底层流场数据。

三项核心技术指标:PAV系列搭载了Posifa第三代热式流量芯片,利用微型热电堆精确检测由质量流量引起的温度梯度变化。 首先是纯固态抗污堵。芯片内部没有任何机械运动部件,独特的固态热隔离结构彻底摒弃了传统竞品中常见的表面空腔或脆弱薄膜,对粉尘堵塞和风压冲击有极强的免疫力。 其次是毫秒级响应。典型响应时间仅仅125ms。在风扇异常或滤网堵塞的瞬间,系统就能在0.125秒内获取真实的底层风速暴跌信号,抢回宝贵的干预窗口。最后是工程级精度。重复性为1%(满量程),准确度为5%(满量程),支持7m/s或15m/s测量范围,完整覆盖微风区与强风道两类场景。

3)从宏观到微观的全栈部署策略为了适应数据中心复杂的物理空间,Posifa提供了两种封装和电气形态,帮助系统集成商构建全栈气流防线。

微观防线(服务器板卡级): PAV3000系列采用极紧凑的SMD封装,工作电压为3.3VDC,可直接输出数字I²C信号。 系统板卡商可以将其贴装在AI服务器主板、液冷盲区内存阵列周边,或者大功率VRM供电死角,精准反馈底层流场,触发精细化的局部风扇调速。

中宏观防线(机箱与设施级): PAV1000系列采用法兰安装结构,工作电压为5VDC,提供模拟电压输出和数字I²C输出两种选项,模拟电压输出的范围在0.5V至4.5V之间。 这个型号适合安装在智能机箱进排风口、冷通道封闭系统,以及HVAC变风量控制和过滤网状态监控当中。它能敏锐捕捉滤网积尘引起的微弱压降,将定期更换滤网升级为基于数据的预测性维护,从根本上降低现场O&M成本。

确定性是最终答案在数据中心PUE持续下探的今天,冷量是最昂贵的运营资源。AI时代的液冷技术拉高了散热的上限,而精细化的风冷管理则死死守住了系统稳定运行的底线,二者缺一不可。无论冷却架构如何演进,风的流动依然是热管理闭环中不可或缺的物理过程。当系统需要确定性的时候,精确、稳定、免维护的底层传感数据,就是打破能效红线的最终答案。 将以上文章缩减一下,突出产品性能和参数.

文章来源于:www.ssrt.com.cn,转载请注明出处.

服务热线:184 1086 5002

监督电话:139 1107 6416

联系电话:+86-010-53325737

公司传真:+86-010-56451107