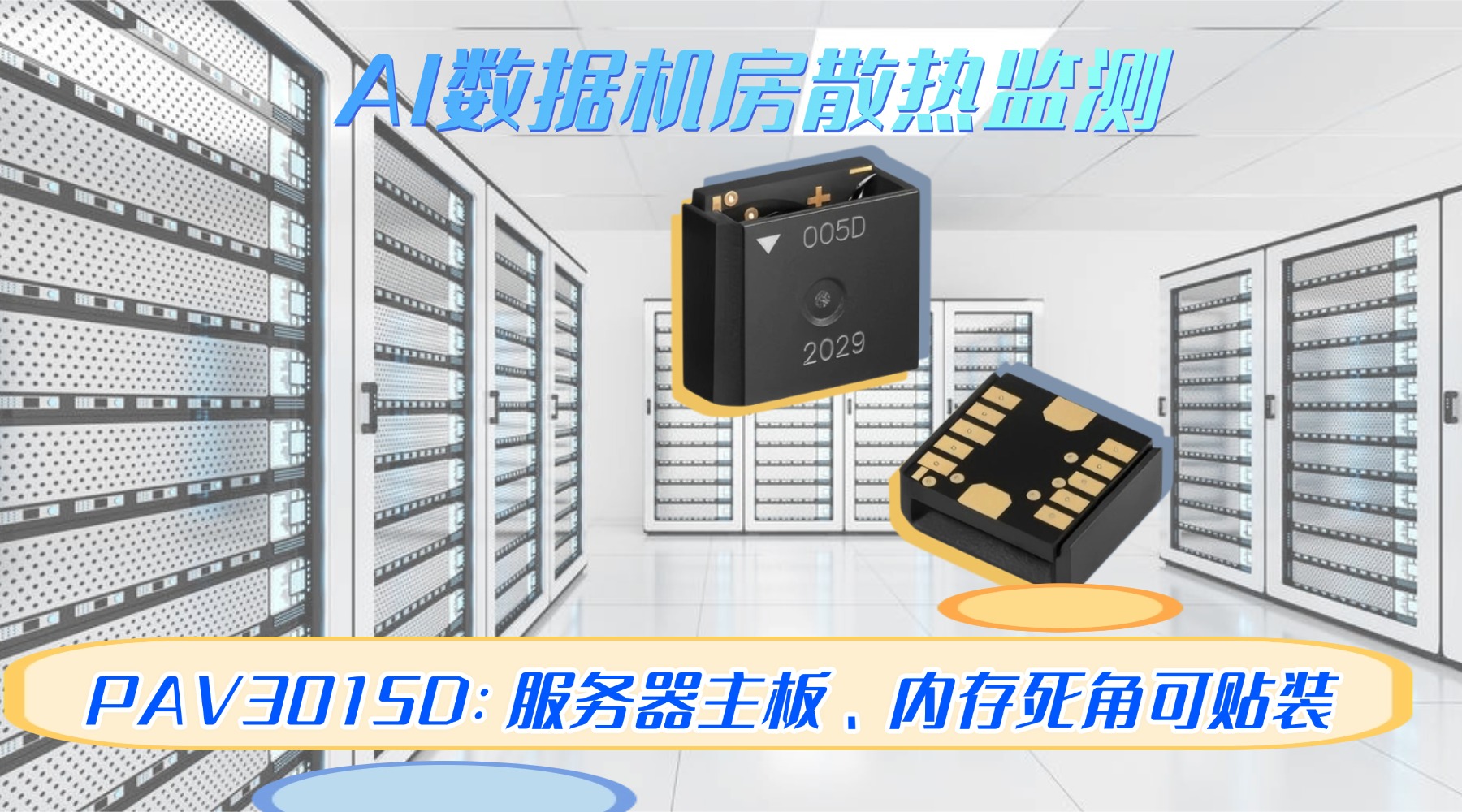

PAV3015D系列采用极紧凑的SMD封装,工作电压为3.3VDC,可直接输出数字I²C信号。 系统板卡商可以将其贴装在AI服务器主板、液冷盲区内存阵列周边,或者大功率VRM供电死角,精准反馈底层流场,触发精细化的局部风扇调速。

想象一下这样一幅场景,一台价值几百万的AI训练集群正在满载运行,突然就出现了高温降频的情况,这时候负责运维的工程师火速去排查液冷系统,然后发现冷却液流量是正常的,冷板温度也是正常的,连冷量分配单元(CDU)都处于平稳运行的状态。那问题究竟出在哪里呢?那些经验丰富的工程师其实都知道,答案往往藏在液冷管路根本覆盖不到的那些犄角旮旯的地方,比如内存条之间的缝隙、高速存储设备的周边、还有VRM供电的那些死角。这些地方在看起来可能不起眼,但只要局部风速稍微衰减那么一点,热量就会迅速堆积起来,最终影响到整个系统的性能。这就是现阶段高功率密度数据中心最需要面对的一个反常识的事实,即使那些昂贵的液冷系统发展到了极致,能够担负起高达95%的散热重任,剩下那看起来微不足道5%的残余热量,依然是能决定整个系统生死存亡的大问题。更何况目前主流方案的液冷覆盖率还停留在60%-80%这个区间,风冷面临的局部热点问题依然严峻。所以,无论是在PUE考核日益严苛的今天,还是着眼可预见的未来,“风液协同”都将是高密度数据中心无法绕开的真实形态。这篇文章我们将从底层物理逻辑出发,重新审视液冷时代被忽视的风冷挑战,探讨如何借助MEMS固态传感技术,以较低成本方式补齐热管理闭环的最后一块拼图。

液冷不是风冷的终结者

算力跃迁带来热量飙升传统数据中心的那个温和时代已经成为了过去式。以前单机柜5-8kW的时代,机房空调加上粗放风冷这套打法确实是够用的。那个时候去现场调参数,基本就是看温度、调风机转速,没有太多复杂的逻辑在里面。但现在AI算力的爆发彻底打破了这种平衡。NVIDIA DGX H100单台峰值功率突破了10kW,新一代的DGX B200更是攀升到了14kW以上。在实际的AI训练集群当中,单机柜的功率密度已经普遍达到了40-60kW这个范围,部分液冷整机柜甚至正在朝着100kW+的方向迈进。在这个量级下面,散热早就不是什么配套工程了。它会直接影响到系统架构的成败和投资回报,是真正的核心生命线。

液冷边界与残余热量面对极高的局部热通量,冷板式液冷凭借水单位体积热容量远高于空气的优势,顺理成章地成为了CPU、GPU等高发热芯片的最优解。然而,根据ASHRAE(美国采暖、制冷与空调工程师学会)指南显示,冷板液冷通常只能带走服务器总发热量的60%-80%。这意味着,剩余那20%-40%的热量依然完全需要依赖风冷进行对流散热。这部分所谓的残余热量并非无足轻重的零头,而是实实在在地堆积在周边组件上。就比如说内存模块,DDR5-4800单条32GB内存的典型功耗大概是8-10W。AI服务器通常会配置16-24条内存,仅这一项的总功耗就可以达到128-240W。再比如高性能存储,企业级NVMe SSD在高负载下面单盘功耗可以达到15-25W,举例,Intel Optane P5800X的峰值能达到25W。还有电源与供电网络,即便是采用80 PLUS Titanium级别的高效电源,转换效率达到了96%,仍然会有4%的巨大能量会以纯热能的形式散发出来。